**SEO关键词:**

ChatGPT技术演进、AI安全、Prompt工程、RAG检索增强生成、大模型微调、多模态大模型、模型可解释性、在线学习、联邦学习、企业AI风险

# **2025年ChatGPT技术演进警示录:AI安全、Prompt工程与RAG正在重塑企业风险边界**

### **引言**

**ChatGPT技术演进**,正在从“好用的聊天工具”快速变成企业核心生产力引擎。表面上看,2025年前后的大模型趋势是更聪明、更便宜、更快接入;但换个角度说,这同样意味着**AI安全**、数据泄露、错误决策、合规审计、模型失控等问题会被同步放大。很多企业今天还把大模型当成“效率外挂”,可现实往往更残酷:一旦把客户资料、内部知识库、审批流、代码仓库、客服系统接入进去,**ChatGPT技术演进**就不再只是技术升级,而是一次真正的风险重组。

尤其当**Prompt工程**趋于标准化、**RAG检索增强生成**深度嵌入业务、多模态模型开始理解图像、语音与文档,企业面对的就不是单点工具,而是一个“会推理、会调用API、会读库、会生成、还能持续自我优化”的智能系统。听起来很酷,对吧?但也正因为如此,许多传统安全边界正在悄悄失效。过去我们担心的是黑客从外部打进来;现在更现实的情况是:员工可能主动把敏感内容喂给模型,插件可能把错误数据写入CRM,模型可能在没有恶意的情况下给出高风险建议。

如果你正在关注**ChatGPT技术演进**、企业AI落地、模型治理或智能化转型,这篇文章想给你的不是“乐观路线图”,而是一份带着警报意味的观察:未来的大模型,不只是能力竞争,更是治理竞争、架构竞争与安全竞争。先把隐患看清,才有资格谈增长。⚠️

—

### **ChatGPT技术演进:Prompt工程、在线学习与微调为何让风险更隐蔽?**

先说一个很多团队容易忽视的事实:**ChatGPT技术演进**的第一步,并不是模型参数越来越大,而是**Prompt工程**越来越像软件工程。以前,Prompt像一段临时指令;现在,Prompt模板、角色设定、上下文注入、工具调用规则、输出格式控制,已经构成了一层新的“逻辑操作系统”。问题来了——当Prompt成为企业业务链路的一部分,它就必须像代码一样被审计、测试、版本管理。否则,看似只是“让AI更懂你”,实则可能把错误、偏见和越权操作写进流程里。

举个典型例子:客服团队为了提升响应效率,把退款政策、用户画像和工单系统接入模型,再配合自动化Prompt模版,让机器人直接生成答复。短期内效果很好,回复快了、人工省了;但一旦Prompt中对规则优先级定义不清,或者外部检索内容质量失真,模型就可能“理直气壮”地给出错误承诺。最棘手的是,这类错误不像系统宕机那样显眼,它往往披着“语言自然、逻辑完整”的外衣,让人更难察觉。

再往前一步看,**大模型微调**和**在线学习**会让这种风险更复杂。企业希望模型“越用越懂业务”,于是把用户反馈、编辑行为、点击数据接入闭环。这当然是趋势,但问题在于:反馈数据未必是干净的,编辑记录也未必代表正确答案。若缺乏高质量标注、权限隔离与回滚机制,模型可能在持续学习中把局部错误“固化”为新常识。你以为是优化,结果却是污染。

这也是为什么很多成熟团队会采用“双轨治理”:一方面用微调和RAG提升准确性,另一方面设置安全护栏,比如敏感词过滤、提示词注入防护、低置信度降级、关键场景人工复核。按照NIST提出的AI风险管理思路,模型不能只看性能指标,还要看可控性、可追踪性和业务后果,参考可见:[NIST AI Risk Management Framework](https://www.nist.gov/itl/ai-risk-management-framework)。

说白了,**ChatGPT技术演进**最危险的地方,不是它会犯错,而是它会在“越来越像专家”的过程中,把错误包装得更可信。企业如果只盯着提效,不盯着治理,那迟早会在某个高价值场景里吃亏。别等到客户投诉、法务介入或审计抽查时,才意识到:原来真正失控的,不是AI本身,而是我们对它的盲目信任。😶

—

### **ChatGPT技术演进:RAG检索增强生成、多模态大模型正在打穿传统安全边界**

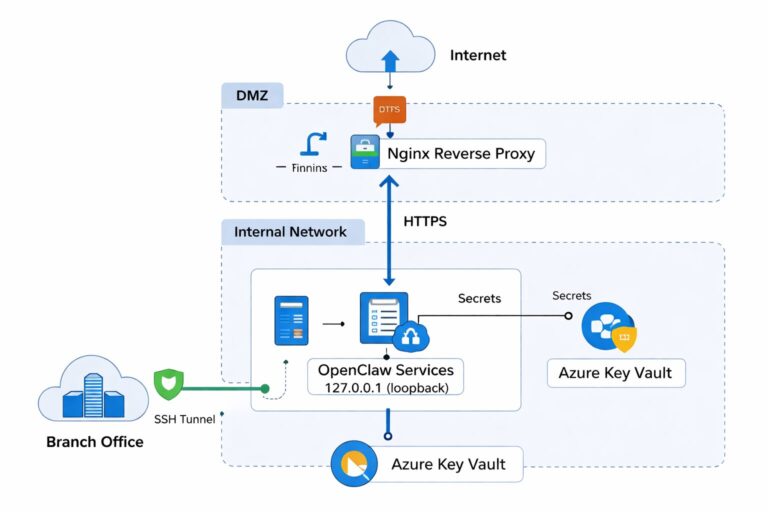

很多人把**RAG检索增强生成**理解为“让模型少胡说八道”的补丁,这个理解没错,但还不够。更准确地说,RAG是把大模型从封闭的语言生成器,升级成了一个能接触企业真实知识资产的执行入口。也正因此,**ChatGPT技术演进**一旦进入RAG阶段,风险性质就变了:过去模型答错,更多是内容质量问题;现在模型若检索错、引用错、越权取数、上下文混入脏数据,后果可能直接变成安全事故和业务事故。

想象一个真实场景:企业把合同库、产品手册、研发文档、邮件摘要和客户服务记录统一做向量索引,接入一个智能问答平台。员工只需问一句,系统就能“秒级”给出结论。效率炸裂,体验丝滑——但这也意味着权限控制必须从“文档是否可见”升级到“片段是否可见、查询是否合规、引用是否可溯源”。否则,一个看似普通的问题,可能把本不该暴露的合同条款、定价细节甚至个人信息拼接出来。

而当**多模态大模型**加入后,边界会被进一步打穿。模型不再只读文字,还能看图纸、识别截图、转写会议录音、解析PDF表格。好处很明显:知识处理能力大幅增强;但风险也水涨船高。比如员工上传一张“无害”的系统截图,模型却从中提取出账号、邮箱、网络结构、工单编号;又或者上传一份扫描版协议,OCR误识别后被模型当成事实引用,最终进入审批、报价或法务回复链路。你看,问题并不轰轰烈烈,往往就藏在这些“顺手一传”“一键总结”的动作里。

下面这张表,可以帮助快速理解企业在**ChatGPT技术演进**中的典型风险:

| 风险场景 | 触发方式 | 可能后果 | 建议控制措施 |

|—|—|—|—|

| Prompt注入 | 恶意文档/网页内容混入上下文 | 模型绕过规则、泄露内容 | 输入清洗、上下文隔离、策略检测 |

| RAG误检索 | 向量召回不准、索引污染 | 答非所问、业务误判 | 重排序、来源标注、置信度阈值 |

| 多模态误识别 | OCR/语音转写错误 | 合同、财务、审批出错 | 人工复核、高风险任务禁自动执行 |

| 权限穿透 | 检索系统与IAM未联动 | 敏感信息泄露 | 细粒度权限、零信任访问控制 |

| 在线学习污染 | 用户反馈被恶意操纵 | 模型质量下降、行为偏移 | 审核样本、可回滚版本、隔离训练 |

所以,企业真正要怕的,不是“AI会不会替代人”,而是“AI是不是正在绕开你熟悉的安全规则”。传统防火墙、终端杀毒、网关过滤并不会自然解决RAG与多模态的治理难题。你需要新的安全视角:知识库要分级、向量库要治理、模型调用要审计、输出要标注来源、关键操作要可回滚。否则,**ChatGPT技术演进**带来的不是智能升级,而是“高效率放大错误”的新型系统风险。⚠️

—

### **ChatGPT技术演进:模型蒸馏、硬件优化、可解释性与隐私保护不能只停留在口号上**

接下来聊一个常被误解的点:很多企业以为模型变小、部署变便宜,就是风险变低。事实上,**模型蒸馏**、剪枝、专用算子优化、边缘推理这些能力,确实会让部署门槛下降,但同时也意味着**ChatGPT技术演进**会更快渗透到终端设备、分支机构、生产现场和移动场景。一旦部署范围扩大,治理难度不是线性上升,而是指数级上升。

举个非常现实的例子:某些企业会把轻量模型部署到本地,用于会议纪要、售后辅助、知识问答或代码生成。这样做有成本优势,也有“数据不出域”的安全收益。但如果你没有建立统一的模型版本管理、日志留存、输出审计和策略下发机制,那么结果很可能是:总部以为自己在推进标准化AI,实际却形成了一堆“野生AI节点”。这些节点用着不同版本的Prompt、不同的知识库快照、不同的安全策略,出了问题根本追不回来。

再说**模型可解释性**。很多企业还停留在“只要回答看起来合理就行”的阶段,这非常危险。尤其在金融、医疗、法律、制造、政务等高责任场景,模型不是会说人话就够了,它必须回答三个问题:结论从哪来?依据是什么?为什么没采纳另一个答案?如果没有来源引用、推理证据、置信度提示和审计日志,那么任何一次误判都可能演变成合规争议。换句话说,可解释性不是学术加分项,而是企业敢不敢真正用AI的分水岭。

隐私保护更不能只写进PPT里。随着**在线学习**、用户行为闭环、跨系统集成越来越普遍,模型接触的数据粒度会越来越细。此时,**差分隐私**、**联邦学习**、脱敏处理、最小权限原则、日志分级保存就变成基础设施,而不是“以后再说”的选配功能。特别是在涉及个人信息、医疗数据、客户交易记录、地理定位和身份认证数据时,如果企业还抱着“先上再补”的心态,那几乎就是给未来埋雷。

从我的观察看,真正成熟的AI团队,都会把**ChatGPT技术演进**拆成三层同步推进:

1. **能力层**:Prompt工程、微调、RAG、多模态、API编排;

2. **治理层**:权限控制、审计日志、模型评测、回滚机制;

3. **合规层**:隐私保护、数据边界、责任归属、人工复核。

少了哪一层,系统都可能跑得快、摔得更惨。别被“降本增效”的口号带节奏。企业真正需要的,从来不是一个会说漂亮话的模型,而是一套在复杂现实里仍然可靠、可控、可问责的智能体系。说直白一点,2025年的竞争,不是“谁先接入AI”,而是“谁能在接入AI后不出事”。这才是**ChatGPT技术演进**背后最硬核、也最残酷的真相。

—

### **常见问题FAQ**

**1. ChatGPT技术演进对普通企业最大的影响是什么?**

最大的影响不是“多了一个聊天工具”,而是企业知识、流程与决策开始被AI重新组织。客服、销售、研发、法务、运维都可能被改写,效率提升明显,但信息泄露、错误引用、责任不清等问题也会同步增加。

**2. Prompt工程为什么会成为企业级能力?**

因为Prompt已经不只是提问技巧,而是业务规则、角色设定、输出格式、工具调用策略的集合。它在很多场景里相当于“轻量级业务逻辑”,必须像代码一样管理。

**3. RAG检索增强生成一定比纯大模型更安全吗?**

不一定。RAG能降低幻觉,但如果知识库脏、索引乱、权限弱,它反而会把错误答案包装得更像“有依据的事实”。所以RAG提升的是“可控潜力”,不是天然安全。

**4. 多模态大模型会带来哪些新增风险?**

图像、音频、PDF、截图中包含大量隐性敏感信息。模型能看得更多,意味着它也可能“读出”更多不该被读取的内容,例如账号、合同细节、内部结构图等。

**5. 企业做大模型微调时,最该注意什么?**

最重要的是训练数据质量、反馈样本筛选、回滚机制和权限隔离。没有这些,模型会在持续优化中被错误数据污染,最终越学越偏。

**6. AI安全是不是只和技术团队有关?**

不是。AI安全同时涉及管理层、法务、合规、业务部门和IT部门。因为模型一旦接入真实流程,风险就不再只是技术问题,而是经营问题和责任问题。

**7. 中小企业是否也需要关注模型可解释性?**

需要。哪怕不是强监管行业,只要AI输出会影响客户沟通、报价、内容发布、审批建议,就必须保留来源、上下文和日志,否则出了问题很难复盘。

**8. 2025年部署AI最稳妥的策略是什么?**

建议从低风险、高价值场景切入,如内部知识问答、文档总结、会议辅助;同时建立最小权限、输出审计、人工复核和数据分级,再逐步扩大自动化范围。

—

别急着把所有系统都“接上AI”。更稳妥的做法,是先把知识库、权限、审计、隐私和模型治理框架打牢,再谈规模化落地。如果你正在评估**ChatGPT技术演进**、**AI安全**、RAG企业知识库、Copilot集成或多模态应用场景,欢迎到 **[帝联信息科技](https://www.de-line.net)** 看看我们的相关服务与实践经验。很多时候,真正值钱的,不是“先上车”,而是“上车后还能安全抵达”。

************

以上内容由我们的AI自动发部机器人提供